20 KiB

Отчёт по лабораторной работе №4

Текотова Виктория, Секирин Артем — А-02-22

Задание 1

1) В среде Google Colab создали новый блокнот (notebook). Импортировали необходимые для работы библиотеки и модули. Настроили блокнот для работы с аппаратным ускорителем GPU.

# импорт модулей

import os

os.chdir('/content/drive/MyDrive/Colab Notebooks/is_lab4')

from tensorflow import keras

from tensorflow.keras import layers

from tensorflow.keras.models import Sequential

import matplotlib.pyplot as plt

import numpy as np

import tensorflow as tf

device_name = tf.test.gpu_device_name()

if device_name != '/device:GPU:0':

raise SystemError('GPU device not found')

print('Found GPU at: {}'.format(device_name))

Found GPU at: /device:GPU:0

2) Загрузили набор данных IMDb, содержащий оцифрованные отзывы на фильмы, размеченные на два класса: позитивные и негативные. При загрузке набора данных параметр seed выбрали равным значению (4k – 1)=3, где k=1 – номер бригады. Вывели размеры полученных обучающих и тестовых массивов данных.

# загрузка датасета

from keras.datasets import imdb

vocabulary_size = 5000

index_from = 3

(X_train, y_train), (X_test, y_test) = imdb.load_data(

path="imdb.npz",

num_words=vocabulary_size,

skip_top=0,

maxlen=None,

seed=23,

start_char=1,

oov_char=2,

index_from=index_from

)

# вывод размерностей

print('Shape of X train:', X_train.shape)

print('Shape of y train:', y_train.shape)

print('Shape of X test:', X_test.shape)

print('Shape of y test:', y_test.shape)

Shape of X train: (25000,)

Shape of y train: (25000,)

Shape of X test: (25000,)

Shape of y test: (25000,)

3) Вывели один отзыв из обучающего множества в виде списка индексов слов. Преобразовали список индексов в текст и вывели отзыв в виде текста. Вывели длину отзыва. Вывели метку класса данного отзыва и название класса (1 – Positive, 0 – Negative).

# создание словаря для перевода индексов в слова

# заргузка словаря "слово:индекс"

word_to_id = imdb.get_word_index()

# уточнение словаря

word_to_id = {key:(value + index_from) for key,value in word_to_id.items()}

word_to_id["<PAD>"] = 0

word_to_id["<START>"] = 1

word_to_id["<UNK>"] = 2

word_to_id["<UNUSED>"] = 3

# создание обратного словаря "индекс:слово"

id_to_word = {value:key for key,value in word_to_id.items()}

print(X_train[26])

print('len:',len(X_train[26]))

[1, 37, 1388, 4, 2739, 495, 94, 96, 143, 49, 2, 875, 551, 19, 195, 2210, 5, 1698, 8, 401, 4, 65, 24, 64, 1728, 21, 400, 642, 45, 77, 6, 137, 237, 207, 258, 141, 6, 1562, 1301, 1562, 737, 22, 10, 10, 4, 22, 9, 1490, 3862, 4, 744, 19, 307, 1385, 5, 2, 2, 4, 2, 2656, 2, 1669, 19, 4, 1074, 200, 4, 55, 406, 55, 3048, 5, 246, 55, 1451, 105, 688, 8, 4, 321, 177, 32, 677, 7, 4, 678, 1850, 26, 1669, 221, 5, 3921, 10, 10, 13, 386, 37, 1388, 4, 2739, 45, 6, 66, 163, 20, 15, 304, 6, 3049, 168, 33, 4, 4352, 15, 75, 70, 2, 23, 257, 85, 5, 4, 2789, 878, 21, 1305, 2, 1773, 7, 2]

len: 130

review_as_text = ' '.join(id_to_word[id] for id in X_train[26])

print(review_as_text)

print('len:',len(review_as_text))

who loves the sun works its way through some subject matter with enough wit and grace to keep the story not only engaging but often hilarious it's been a while since i've found such a thoroughly touching thoroughly enjoyable film br br the film is gorgeous drawing the eye with beautiful scenery and the imagery wonderfully with the tension between the very human very flawed and yet very likable characters due to the excellent cast all five of the major players are wonderfully interesting and dynamic br br i recommend who loves the sun it's a really funny movie that takes a poignant look at the hurts that we can on each other and the amazingly difficult but equally process of len: 738

4) Вывели максимальную и минимальную длину отзыва в обучающем множестве.

print('MAX Len: ',len(max(X_train, key=len)))

print('MIN Len: ',len(min(X_train, key=len)))

MAX Len: 2494

MIN Len: 11

5) Провели предобработку данных. Выбрали единую длину, к которой будут приведены все отзывы. Короткие отзывы дополнили спецсимволами, а длинные обрезали до выбранной длины.

# предобработка данных

from tensorflow.keras.utils import pad_sequences

max_words = 500

X_train = pad_sequences(X_train, maxlen=max_words, value=0, padding='pre', truncating='post')

X_test = pad_sequences(X_test, maxlen=max_words, value=0, padding='pre', truncating='post')

6) Повторили пункт 4.

print('MAX Len: ',len(max(X_train, key=len)))

print('MIN Len: ',len(min(X_train, key=len)))

MAX Len: 500

MIN Len: 500

7) Повторили пункт 3. Сделали вывод о том, как отзыв преобразовался после предобработки.

print(X_train[26])

print('len:',len(X_train[26]))

[ 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 1 37 1388 4 2739 495 94 96 143 49 2 875 551 19 195 2210 5 1698 8 401 4 65 24 64 1728 21 400 642 45 77 6 137 237 207 258 141 6 1562 1301 1562 737 22 10 10 4 22 9 1490 3862 4 744 19 307 1385 5 2 2 4 2 2656 2 1669 19 4 1074 200 4 55 406 55 3048 5 246 55 1451 105 688 8 4 321 177 32 677 7 4 678 1850 26 1669 221 5 3921 10 10 13 386 37 1388 4 2739 45 6 66 163 20 15 304 6 3049 168 33 4 4352 15 75 70 2 23 257 85 5 4 2789 878 21 1305 2 1773 7 2]

len: 500

review_as_text = ' '.join(id_to_word[id] for id in X_train[26])

print(review_as_text)

print('len:',len(review_as_text))

who loves the sun works its way through some subject matter with enough wit and grace to keep the story not only engaging but often hilarious it's been a while since i've found such a thoroughly touching thoroughly enjoyable film br br the film is gorgeous drawing the eye with beautiful scenery and the imagery wonderfully with the tension between the very human very flawed and yet very likable characters due to the excellent cast all five of the major players are wonderfully interesting and dynamic br br i recommend who loves the sun it's a really funny movie that takes a poignant look at the hurts that we can on each other and the amazingly difficult but equally process of

len: 2958

После обработки в начало отзыва добавилось необходимое количество токенов , чтобы отзыв был длинной в 500 индексов.

8) Вывели предобработанные массивы обучающих и тестовых данных и их размерности.

# вывод данных

print('X train: \n',X_train)

print('X train: \n',X_test)

# вывод размерностей

print('Shape of X train:', X_train.shape)

print('Shape of X test:', X_test.shape)

X train:

[[ 0 0 0 ... 12 38 76]

[ 0 0 0 ... 33 4 130]

[ 0 0 0 ... 437 7 58]

...

[ 0 0 0 ... 1874 1553 422]

[ 0 0 0 ... 18 1552 234]

[ 0 0 0 ... 7 87 1090]]

X train:

[[ 0 0 0 ... 6 194 717]

[ 0 0 0 ... 30 87 292]

[ 0 0 0 ... 495 55 73]

...

[ 0 0 0 ... 7 12 908]

[ 0 0 0 ... 61 477 2302]

[ 0 0 0 ... 5 68 4580]]

Shape of X train: (25000, 500)

Shape of X test: (25000, 500)

9) Реализовали модель рекуррентной нейронной сети, состоящей из слоев Embedding, LSTM, Dropout, Dense, и обучили ее на обучающих данных с выделением части обучающих данных в качестве валидационных. Вывели информацию об архитектуре нейронной сети. Добились качества обучения по метрике accuracy не менее 0.8.

embed_dim = 32

lstm_units = 64

model = Sequential()

model.add(layers.Embedding(input_dim=vocabulary_size, output_dim=embed_dim, input_length=max_words, input_shape=(max_words,)))

model.add(layers.LSTM(lstm_units))

model.add(layers.Dropout(0.5))

model.add(layers.Dense(1, activation='sigmoid'))

model.summary()

Model: "sequential"

┏━━━━━━━━━━━━━━━━━━━━━━━━━━━━━━━━━┳━━━━━━━━━━━━━━━━━━━━━━━━┳━━━━━━━━━━━━━━━┓

┃ Layer (type) ┃ Output Shape ┃ Param # ┃

┡━━━━━━━━━━━━━━━━━━━━━━━━━━━━━━━━━╇━━━━━━━━━━━━━━━━━━━━━━━━╇━━━━━━━━━━━━━━━┩

│ embedding (Embedding) │ (None, 500, 32) │ 160,000 │

├─────────────────────────────────┼────────────────────────┼───────────────┤

│ lstm (LSTM) │ (None, 64) │ 24,832 │

├─────────────────────────────────┼────────────────────────┼───────────────┤

│ dropout (Dropout) │ (None, 64) │ 0 │

├─────────────────────────────────┼────────────────────────┼───────────────┤

│ dense (Dense) │ (None, 1) │ 65 │

└─────────────────────────────────┴────────────────────────┴───────────────┘

Total params: 184,897 (722.25 KB)

Trainable params: 184,897 (722.25 KB)

Non-trainable params: 0 (0.00 B)

# компилируем и обучаем модель

batch_size = 64

epochs = 3

model.compile(loss="binary_crossentropy", optimizer="adam", metrics=["accuracy"])

model.fit(X_train, y_train, batch_size=batch_size, epochs=epochs, validation_split=0.2)

Epoch 1/3

313/313 ━━━━━━━━━━━━━━━━━━━━ 12s 23ms/step - accuracy: 0.6709 - loss: 0.5808 - val_accuracy: 0.8360 - val_loss: 0.3821

Epoch 2/3

313/313 ━━━━━━━━━━━━━━━━━━━━ 7s 22ms/step - accuracy: 0.8632 - loss: 0.3428 - val_accuracy: 0.8552 - val_loss: 0.3822

Epoch 3/3

313/313 ━━━━━━━━━━━━━━━━━━━━ 6s 20ms/step - accuracy: 0.8972 - loss: 0.2699 - val_accuracy: 0.8580 - val_loss: 0.3352

<keras.src.callbacks.history.History at 0x7a52f7a673b0>

test_loss, test_acc = model.evaluate(X_test, y_test)

print(f"\nTest accuracy: {test_acc}")

782/782 ━━━━━━━━━━━━━━━━━━━━ 6s 8ms/step - accuracy: 0.8476 - loss: 0.3551

Test accuracy: 0.8491600155830383

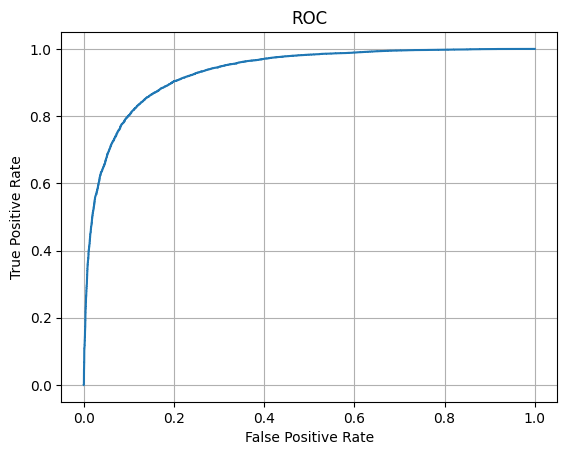

10) Оценили качество обучения на тестовых данных:

- вывели значение метрики качества классификации на тестовых данных

- вывели отчет о качестве классификации тестовой выборки

- построили ROC-кривую по результату обработки тестовой выборки и вычислили площадь под ROC-кривой (AUC ROC)

#значение метрики качества классификации на тестовых данных

print(f"\nTest accuracy: {test_acc}")

Test accuracy: 0.8491600155830383

#отчет о качестве классификации тестовой выборки

y_score = model.predict(X_test)

y_pred = [1 if y_score[i,0]>=0.5 else 0 for i in range(len(y_score))]

from sklearn.metrics import classification_report

print(classification_report(y_test, y_pred, labels = [0, 1], target_names=['Negative', 'Positive']))

782/782 ━━━━━━━━━━━━━━━━━━━━ 6s 8ms/step

precision recall f1-score supportNegative 0.81 0.91 0.86 12500

Positive 0.90 0.79 0.84 12500

accuracy 0.85 25000

macro avg 0.85 0.85 0.85 25000

weighted avg 0.85 0.85 0.85 25000

#построение ROC-кривой и AUC ROC

from sklearn.metrics import roc_curve, auc

fpr, tpr, thresholds = roc_curve(y_test, y_score)

plt.plot(fpr, tpr)

plt.grid()

plt.xlabel('False Positive Rate')

plt.ylabel('True Positive Rate')

plt.title('ROC')

plt.show()

print('AUC ROC:', auc(fpr, tpr))

AUC ROC: 0.9323916576

11) Сделали выводы по результатам применения рекуррентной нейронной сети для решения задачи определения тональности текста.

Таблица1:

| Модель | Количество настраиваемых параметров | Количество эпох обучения | Качество классификации тестовой выборки |

|---|---|---|---|

| Рекуррентная | 184 897 | 3 | accuracy:0.8476 ; loss:0.3551 ; AUC ROC:0.9324 |