23 KiB

Отчет по лабораторной работе №1

Пивоваров Я.В., Сидора Д.А., А-02-22

1. В среде Google Colab создание нового блокнота.

import os

os.chdir('/content/drive/MyDrive/Colab Notebooks')

- Импорт библиотек и модулей

from tensorflow import keras

import matplotlib.pyplot as plt

import numpy as np

import sklearn

2. Загрузка и рассмотрение набора данных

from keras.datasets import mnist

(X_train, y_train), (X_test, y_test) = mnist.load_data()

3. Разбиение набора данных на обучающий и тестовый.

from sklearn.model_selection import train_test_split

- Объединение в один набор.

X = np.concatenate((X_train, X_test))

y = np.concatenate((y_train, y_test))

- Разбиение по вариантам. (4 бригада -> k=4*4-1)

X_train, X_test, y_train, y_test = train_test_split(X, y,test_size = 10000,train_size = 60000, random_state = 15)

- Вывод размерностей.

print('Shape of X train:', X_train.shape)

print('Shape of y train:', y_train.shape)

Shape of X train: (60000, 28, 28) Shape of y train: (60000,)

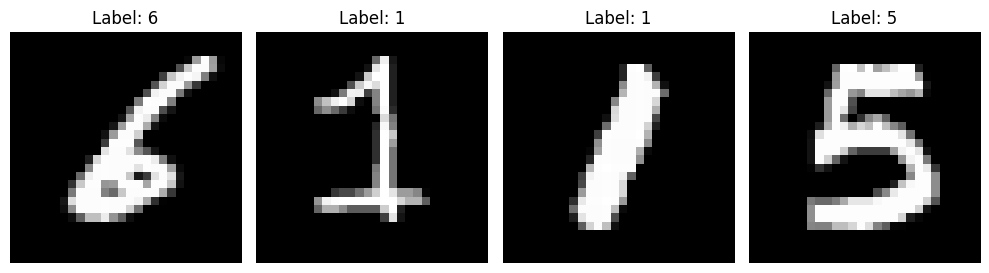

4. Вывод обучающих данных.

- Выведем первые четыре элемента обучающих данных.

plt.figure(figsize=(10, 3))

for i in range(4):

plt.subplot(1, 4, i + 1)

plt.imshow(X_train[i], cmap='gray')

plt.title(f'Label: {y_train[i]}')

plt.axis('off')

plt.tight_layout()

plt.show()

5. Предобработка данных.

- Развернем каждое изображение в вектор.

num_pixels = X_train.shape[1] * X_train.shape[2]

X_train = X_train.reshape(X_train.shape[0], num_pixels) / 255

X_test = X_test.reshape(X_test.shape[0], num_pixels) / 255

print('Shape of transformed X train:', X_train.shape)

Shape of transformed X train: (60000, 784)

- Переведем метки в one-hot.

from keras.utils import to_categorical

y_train = to_categorical(y_train)

y_test = to_categorical(y_test)

print('Shape of transformed y train:', y_train.shape)

num_classes = y_train.shape[1]

Shape of transformed y train: (60000, 10)

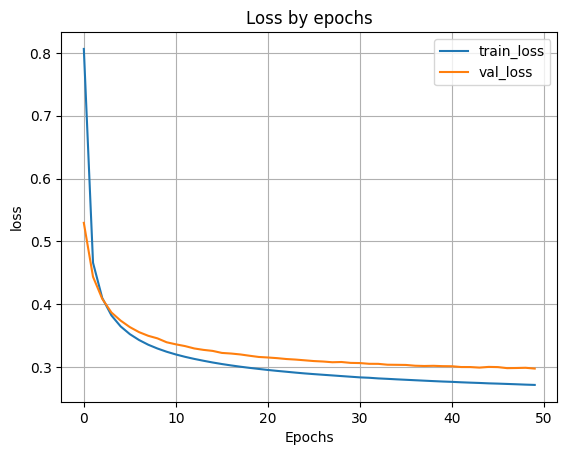

6. Реализация и обучение однослойной нейронной сети.

from keras.models import Sequential

from keras.layers import Dense

- Создаем модель - объявляем ее объектом класса Sequential, добавляем выходной слой.

model = Sequential()

model.add(Dense(units=num_classes, activation='softmax'))

- Компилируем модель.

model.compile(loss='categorical_crossentropy', optimizer='sgd', metrics=['accuracy'])

print(model.summary())

Model: "sequential" ┏━━━━━━━━━━━━━━━━━━━━━━━━━━━━━━━━━┳━━━━━━━━━━━━━━━━━━━━━━━━┳━━━━━━━━━━━━━━━┓ ┃ Layer (type) ┃ Output Shape ┃ Param # ┃ ┡━━━━━━━━━━━━━━━━━━━━━━━━━━━━━━━━━╇━━━━━━━━━━━━━━━━━━━━━━━━╇━━━━━━━━━━━━━━━┩ │ dense (Dense) │ ? │ 0 (unbuilt) │ └─────────────────────────────────┴────────────────────────┴───────────────┘ Total params: 0 (0.00 B) Trainable params: 0 (0.00 B) Non-trainable params: 0 (0.00 B) None

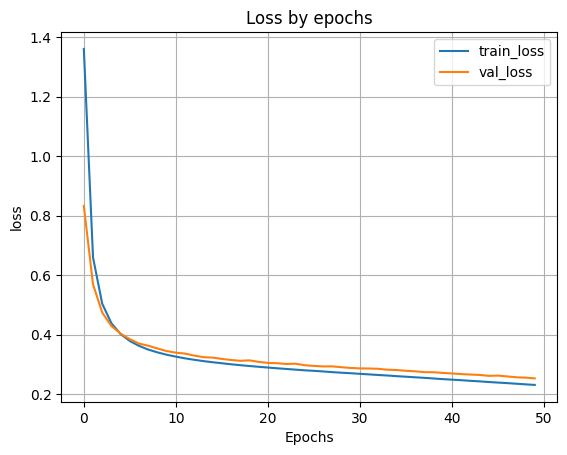

- Обучаем модель.

H = model.fit(X_train, y_train, validation_split=0.1, epochs=50)

- Выводим график функции ошибки

plt.plot(H.history['loss'])

plt.plot(H.history['val_loss'])

plt.grid()

plt.xlabel('Epochs')

plt.ylabel('loss')

plt.legend(['train_loss', 'val_loss'])

plt.title('Loss by epochs')

plt.show()

7. Применение модели к тестовым данным.

scores = model.evaluate(X_test, y_test)

print('Loss on test data:', scores[0])

print('Accuracy on test data:', scores[1])

accuracy: 0.9313 - loss: 0.2648 Loss on test data: 0.2729383409023285 Accuracy on test data: 0.9290000200271606

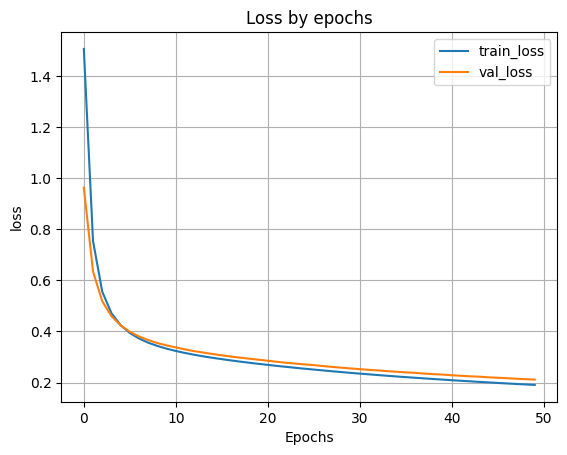

8. Добавление одного скрытого слоя.

- При 100 нейронах в скрытом слое.

model100 = Sequential()

model100.add(Dense(units=100,input_dim=num_pixels, activation='sigmoid'))

model100.add(Dense(units=num_classes, activation='softmax'))

model100.compile(loss='categorical_crossentropy', optimizer='sgd', metrics=['accuracy']

print(model100.summary())

Model: "sequential_1" ┏━━━━━━━━━━━━━━━━━━━━━━━━━━━━━━━━━┳━━━━━━━━━━━━━━━━━━━━━━━━┳━━━━━━━━━━━━━━━┓ ┃ Layer (type) ┃ Output Shape ┃ Param # ┃ ┡━━━━━━━━━━━━━━━━━━━━━━━━━━━━━━━━━╇━━━━━━━━━━━━━━━━━━━━━━━━╇━━━━━━━━━━━━━━━┩ │ dense_1 (Dense) │ (None, 100) │ 78,500 │ ├─────────────────────────────────┼────────────────────────┼───────────────┤ │ dense_2 (Dense) │ (None, 10) │ 1,010 │ └─────────────────────────────────┴────────────────────────┴───────────────┘ Total params: 79,510 (310.59 KB) Trainable params: 79,510 (310.59 KB) Non-trainable params: 0 (0.00 B) None

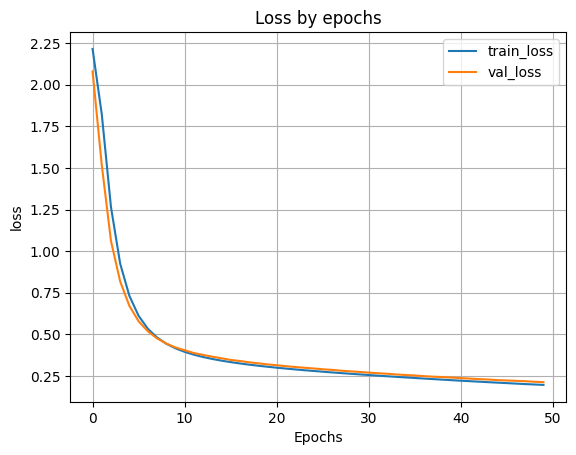

- Обучение модели.

H = model100.fit(X_train, y_train, validation_split=0.1, epochs=50)

- График функции ошибки.

plt.plot(H.history['loss'])

plt.plot(H.history['val_loss'])

plt.grid()

plt.xlabel('Epochs')

plt.ylabel('loss')

plt.legend(['train_loss', 'val_loss'])

plt.title('Loss by epochs')

plt.show()

scores = model100.evaluate(X_test, y_test)

print('Loss on test data:', scores[0])

print('Accuracy on test data:', scores[1])

accuracy: 0.9500 - loss: 0.1884 Loss on test data: 0.1930633932352066 Accuracy on test data: 0.9473999738693237

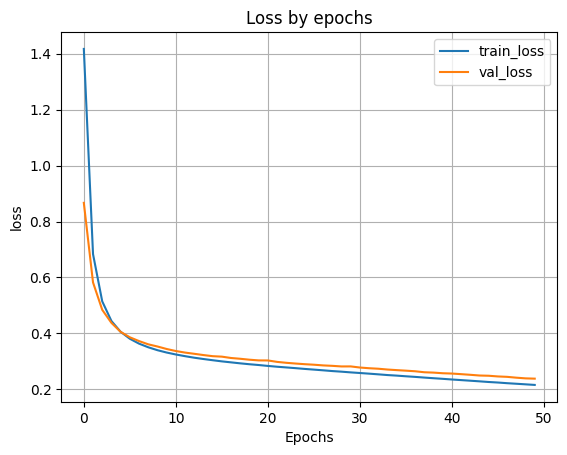

- При 300 нейронах в скрытом слое.

model300 = Sequential()

model300.add(Dense(units=300,input_dim=num_pixels, activation='sigmoid'))

model300.add(Dense(units=num_classes, activation='softmax'))

model300.compile(loss='categorical_crossentropy', optimizer='sgd', metrics=['accuracy'])

print(model300.summary())

Model: "sequential_2" ┏━━━━━━━━━━━━━━━━━━━━━━━━━━━━━━━━━┳━━━━━━━━━━━━━━━━━━━━━━━━┳━━━━━━━━━━━━━━━┓ ┃ Layer (type) ┃ Output Shape ┃ Param # ┃ ┡━━━━━━━━━━━━━━━━━━━━━━━━━━━━━━━━━╇━━━━━━━━━━━━━━━━━━━━━━━━╇━━━━━━━━━━━━━━━┩ │ dense_3 (Dense) │ (None, 300) │ 235,500 │ ├─────────────────────────────────┼────────────────────────┼───────────────┤ │ dense_4 (Dense) │ (None, 10) │ 3,010 │ └─────────────────────────────────┴────────────────────────┴───────────────┘ Total params: 238,510 (931.68 KB) Trainable params: 238,510 (931.68 KB) Non-trainable params: 0 (0.00 B) None

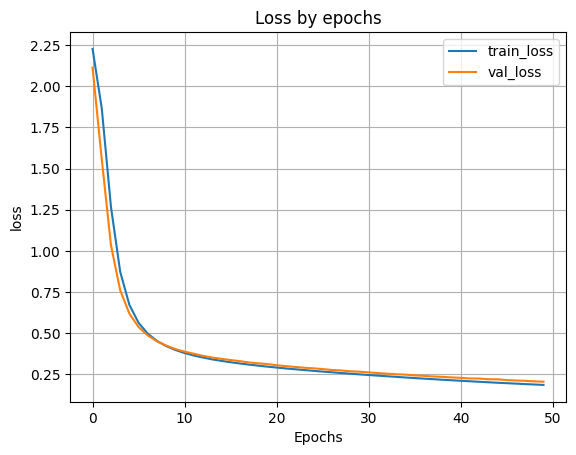

- Обучение модели.

H = model300.fit(X_train, y_train, validation_split=0.1, epochs=50)

- Вывод графиков функции ошибки.

plt.plot(H.history['loss'])

plt.plot(H.history['val_loss'])

plt.grid()

plt.xlabel('Epochs')

plt.ylabel('loss')

plt.legend(['train_loss', 'val_loss'])

plt.title('Loss by epochs')

plt.show()

scores = model300.evaluate(X_test, y_test)

print('Loss on test data:', scores[0])

print('Accuracy on test data:', scores[1])

accuracy: 0.9444 - loss: 0.2126 Loss on test data: 0.2181043177843094 Accuracy on test data: 0.9419999718666077

- При 500 нейронах в скрытом слое.

model500 = Sequential()

model500.add(Dense(units=500,input_dim=num_pixels, activation='sigmoid'))

model500.add(Dense(units=num_classes, activation='softmax'))

model500.compile(loss='categorical_crossentropy', optimizer='sgd', metrics=['accuracy'])

print(model500.summary())

Model: "sequential_3" ┏━━━━━━━━━━━━━━━━━━━━━━━━━━━━━━━━━┳━━━━━━━━━━━━━━━━━━━━━━━━┳━━━━━━━━━━━━━━━┓ ┃ Layer (type) ┃ Output Shape ┃ Param # ┃ ┡━━━━━━━━━━━━━━━━━━━━━━━━━━━━━━━━━╇━━━━━━━━━━━━━━━━━━━━━━━━╇━━━━━━━━━━━━━━━┩ │ dense_5 (Dense) │ (None, 500) │ 392,500 │ ├─────────────────────────────────┼────────────────────────┼───────────────┤ │ dense_6 (Dense) │ (None, 10) │ 5,010 │ └─────────────────────────────────┴────────────────────────┴───────────────┘ Total params: 397,510 (1.52 MB) Trainable params: 397,510 (1.52 MB) Non-trainable params: 0 (0.00 B) None

- Обучение модели.

H = model500.fit(X_train, y_train, validation_split=0.1, epochs=50)

- Вывод графиков функции ошибки.

plt.plot(H.history['loss'])

plt.plot(H.history['val_loss'])

plt.grid()

plt.xlabel('Epochs')

plt.ylabel('loss')

plt.legend(['train_loss', 'val_loss'])

plt.title('Loss by epochs')

plt.show()

scores = model500.evaluate(X_test, y_test)

print('Loss on test data:', scores[0])

print('Accuracy on test data:', scores[1])

accuracy: 0.9401 - loss: 0.2261 Loss on test data: 0.2324201464653015 Accuracy on test data: 0.9376000165939331

Как мы видим, лучшая метрика получилась при архитектуре со 100 нейронами в скрытом слое: Ошибка на тестовых данных: 0.1930633932352066 Точность тестовых данных: 0.9473999738693237

9. Добавление второго скрытого слоя.

- При 50 нейронах во втором скрытом слое.

model10050 = Sequential()

model10050.add(Dense(units=100,input_dim=num_pixels, activation='sigmoid'))

model10050.add(Dense(units=50,activation='sigmoid'))

model10050.add(Dense(units=num_classes, activation='softmax'))

model10050.compile(loss='categorical_crossentropy', optimizer='sgd', metrics=['accuracy'])

print(model10050.summary())

Model: "sequential_4" ┏━━━━━━━━━━━━━━━━━━━━━━━━━━━━━━━━━┳━━━━━━━━━━━━━━━━━━━━━━━━┳━━━━━━━━━━━━━━━┓ ┃ Layer (type) ┃ Output Shape ┃ Param # ┃ ┡━━━━━━━━━━━━━━━━━━━━━━━━━━━━━━━━━╇━━━━━━━━━━━━━━━━━━━━━━━━╇━━━━━━━━━━━━━━━┩ │ dense_7 (Dense) │ (None, 100) │ 78,500 │ ├─────────────────────────────────┼────────────────────────┼───────────────┤ │ dense_8 (Dense) │ (None, 50) │ 5,050 │ ├─────────────────────────────────┼────────────────────────┼───────────────┤ │ dense_9 (Dense) │ (None, 10) │ 510 │ └─────────────────────────────────┴────────────────────────┴───────────────┘ Total params: 84,060 (328.36 KB) Trainable params: 84,060 (328.36 KB) Non-trainable params: 0 (0.00 B) None

- Обучаем модель.

H = model10050.fit(X_train, y_train, validation_split=0.1, epochs=50)

- Выводим график функции ошибки.

plt.plot(H.history['loss'])

plt.plot(H.history['val_loss'])

plt.grid()

plt.xlabel('Epochs')

plt.ylabel('loss')

plt.legend(['train_loss', 'val_loss'])

plt.title('Loss by epochs')

plt.show()

scores = model10050.evaluate(X_test, y_test)

print('Loss on test data:', scores[0])

print('Accuracy on test data:', scores[1])

accuracy: 0.9476 - loss: 0.1931 Loss on test data: 0.1974852979183197 Accuracy on test data: 0.9449999928474426

- При 100 нейронах во втором скрытом слое.

model100100 = Sequential()

model100100.add(Dense(units=100,input_dim=num_pixels, activation='sigmoid'))

model100100.add(Dense(units=100,activation='sigmoid'))

model100100.add(Dense(units=num_classes, activation='softmax'))

model100100.compile(loss='categorical_crossentropy', optimizer='sgd', metrics=['accuracy'])

print(model100100.summary())

Model: "sequential_5" ┏━━━━━━━━━━━━━━━━━━━━━━━━━━━━━━━━━┳━━━━━━━━━━━━━━━━━━━━━━━━┳━━━━━━━━━━━━━━━┓ ┃ Layer (type) ┃ Output Shape ┃ Param # ┃ ┡━━━━━━━━━━━━━━━━━━━━━━━━━━━━━━━━━╇━━━━━━━━━━━━━━━━━━━━━━━━╇━━━━━━━━━━━━━━━┩ │ dense_10 (Dense) │ (None, 100) │ 78,500 │ ├─────────────────────────────────┼────────────────────────┼───────────────┤ │ dense_11 (Dense) │ (None, 100) │ 10,100 │ ├─────────────────────────────────┼────────────────────────┼───────────────┤ │ dense_12 (Dense) │ (None, 10) │ 1,010 │ └─────────────────────────────────┴────────────────────────┴───────────────┘ Total params: 89,610 (350.04 KB) Trainable params: 89,610 (350.04 KB) Non-trainable params: 0 (0.00 B) None

- Обучаем модель.

H = model100100.fit(X_train, y_train, validation_split=0.1, epochs=50)

- Выводим график функции ошибки.

plt.plot(H.history['loss'])

plt.plot(H.history['val_loss'])

plt.grid()

plt.xlabel('Epochs')

plt.ylabel('loss')

plt.legend(['train_loss', 'val_loss'])

plt.title('Loss by epochs')

plt.show()

scores = model100100.evaluate(X_test, y_test)

print('Loss on test data:', scores[0])

print('Accuracy on test data:', scores[1])

accuracy: 0.9485 - loss: 0.1814 Loss on test data: 0.18734164535999298 Accuracy on test data: 0.9470000267028809

10. Результаты исследования архитектур нейронной сети.

| Количество скрытых слоев | Количество нейронов в первом скрытом слое | Количество нейронов во втором скрытом слое | Значение метрики качества классификации |

|---|---|---|---|

| 0 | - | - | 0.9290000200271606 |

| 1 | 100 | - | 0.9473999738693237 |

| 1 | 300 | - | 0.9419999718666077 |

| 1 | 500 | - | 0.9376000165939331 |

| 2 | 100 | 50 | 0.9449999928474426 |

| 2 | 100 | 100 | 0.9470000267028809 |

Анализ результатов позволяет сделать вывод, что наилучшее качество классификации (порядка 94.7%) достигается при использовании моделей с относительно простой архитектурой. Наибольшую точность показали однослойная сеть со 100 нейронами и двухслойная конфигурация с 100 и 100 нейронами соответственно.

11. Сохранение наилучшей модели на диск.

model100.save('/content/drive/MyDrive/Colab Notebooks/best_model/model100.keras')

- Загрузка лучшей модели с диска.

from keras.models import load_model

model = load_model('/content/drive/MyDrive/Colab Notebooks/best_model/model100.keras')

12. Вывод тестовых изображений и результатов распознаваний.

n = 222

result = model.predict(X_test[n:n+1])

print('NN output:', result)

plt.imshow(X_test[n].reshape(28,28), cmap=plt.get_cmap('gray'))

plt.show()

print('Real mark: ', str(np.argmax(y_test[n])))

print('NN answer: ', str(np.argmax(result)))

NN output: [[3.7926259e-03 9.0994104e-07 2.0981293e-04 2.9478846e-02 2.0727816e-06 9.6508384e-01 7.6052487e-07 5.7595258e-05 1.0619552e-03 3.1140275e-04]]

Real mark: 5 NN answer: 5

n = 123

result = model.predict(X_test[n:n+1])

print('NN output:', result)

plt.imshow(X_test[n].reshape(28,28), cmap=plt.get_cmap('gray'))

plt.show()

print('Real mark: ', str(np.argmax(y_test[n])))

print('NN answer: ', str(np.argmax(result)))

NN output: [[7.6678516e-06 2.1507578e-06 2.5754166e-04 6.3994766e-04 2.8644723e-04 2.3038971e-04 1.0776109e-05 2.3045135e-05 9.9186021e-01 6.6818334e-03]]

Real mark: 8 NN answer: 8

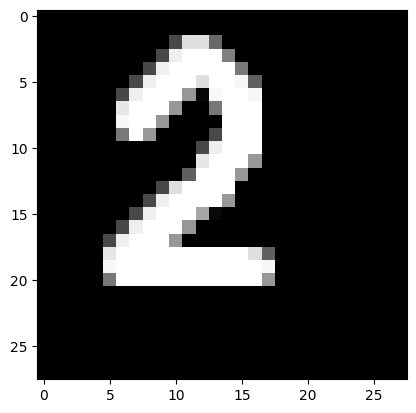

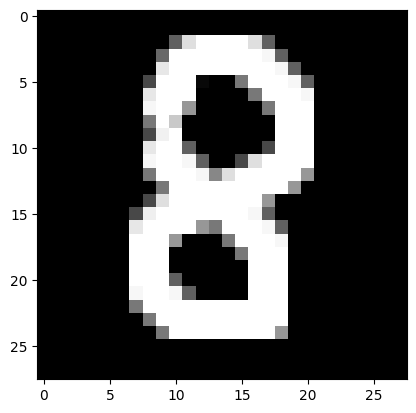

13. Тестирование на собственных изображениях.

- Загрузка 1 собственного изображения.

from PIL import Image

file_data = Image.open('test.png')

file_data = file_data.convert('L') # перевод в градации серого

test_img = np.array(file_data)

- Вывод собственного изображения.

plt.imshow(test_img, cmap=plt.get_cmap('gray'))

plt.show()

- Предобработка.

test_img = test_img / 255

test_img = test_img.reshape(1, num_pixels)

- Распознавание.

result = model.predict(test_img)

print('I think it\'s ', np.argmax(result))

I think it's 2

- Тест 2 изображения.

from PIL import Image

file2_data = Image.open('test2.png')

file2_data = file2_data.convert('L') # перевод в градации серого

test2_img = np.array(file2_data)

plt.imshow(test2_img, cmap=plt.get_cmap('gray'))

plt.show()

test2_img = test2_img / 255

test2_img = test2_img.reshape(1, num_pixels)

result_2 = model.predict(test2_img)

print('I think it\'s ', np.argmax(result_2))

I think it's 8

Сеть корректно распознала цифры на изображениях.

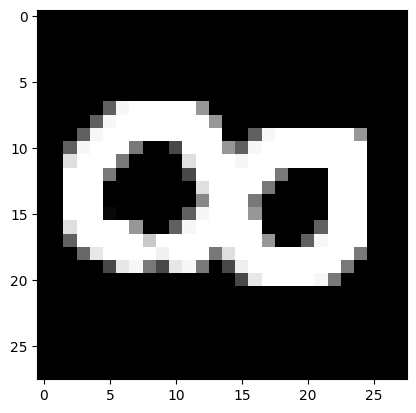

14. Тестирование на повернутых изображениях.

from PIL import Image

file90_data = Image.open('test90.png')

file90_data = file90_data.convert('L') # перевод в градации серого

test90_img = np.array(file90_data)

plt.imshow(test90_img, cmap=plt.get_cmap('gray'))

plt.show()

test90_img = test90_img / 255

test90_img = test90_img.reshape(1, num_pixels)

result_3 = model.predict(test90_img)

print('I think it\'s ', np.argmax(result_3))

I think it's 8

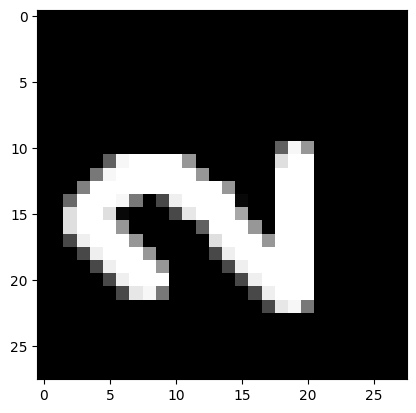

from PIL import Image

file902_data = Image.open('test90_2.png')

file902_data = file902_data.convert('L') # перевод в градации серого

test902_img = np.array(file902_data)

plt.imshow(test902_img, cmap=plt.get_cmap('gray'))

plt.show()

test902_img = test902_img / 255

test902_img = test902_img.reshape(1, num_pixels)

result_4 = model.predict(test902_img)

print('I think it\'s ', np.argmax(result_4))

I think it's 4

Сеть не распознала цифры на изображениях корректно.