14 KiB

Отчет по лабораторной работе №1

Юсуфов Юнус,Романов Мирон , А-01-22

1. В среде GoogleColab создали блокнот. Импортировали все нужные модули для работы

from tensorflow import keras

import matplotlib.pyplot as plt

import numpy as np

import sklearn

from tensorflow.keras.utils import to_categorical

from keras.models import Sequential

from keras.layers import Dense

2. Загрузили датасет MNIST, содержащий рукописные цифры

from keras.datasets import mnist

(X_train, y_train), (X_test, y_test) = mnist.load_data()

3. Разбили набор данных на обучающие и тестовые выборки

from sklearn.model_selection import train_test_split

- объединили в один набор

X = np.concatenate((X_train, X_test))

y = np.concatenate((y_train, y_test))

- разбили по вариантам

X_train, X_test, y_train, y_test = train_test_split(X, y,test_size = 10000,train_size = 60000, random_state = 35)

- Вывели размерности

print('Shape of X train:', X_train.shape)

print('Shape of y train:', y_train.shape)

Shape of X train: (60000, 28, 28) Shape of y train: (60000,)

4. Вывод элементов обучающих данных

- Вывел 4-е элемента выборки

print(y_train[0])

plt.imshow(X_train[0], cmap=plt.get_cmap('gray'))

plt.show()

print(y_train[1])

plt.imshow(X_train[1], cmap=plt.get_cmap('gray'))

plt.show()

print(y_train[2])

plt.imshow(X_train[2], cmap=plt.get_cmap('gray'))

plt.show()

print(y_train[3])

plt.imshow(X_train[3], cmap=plt.get_cmap('gray'))

plt.show()

0

9

7

5

5. Предобработка данных

- развернули каждое изображение 28*28 в вектор 784

num_pixels = X_train.shape[1] * X_train.shape[2]

X_train = X_train.reshape(X_train.shape[0], num_pixels) / 255

X_test = X_test.reshape(X_test.shape[0], num_pixels) / 255

print('Shape of transformed X train:', X_train.shape)

Shape of transformed X train: (60000, 784)

- перевели метки в one-hot

from keras.utils import to_categorical

y_train = to_categorical(y_train)

y_test = to_categorical(y_test)

print('Shape of transformed y train:', y_train.shape)

num_classes = y_train.shape[1]

Shape of transformed y train: (60000, 10)

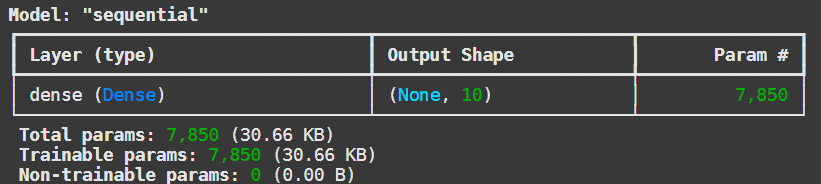

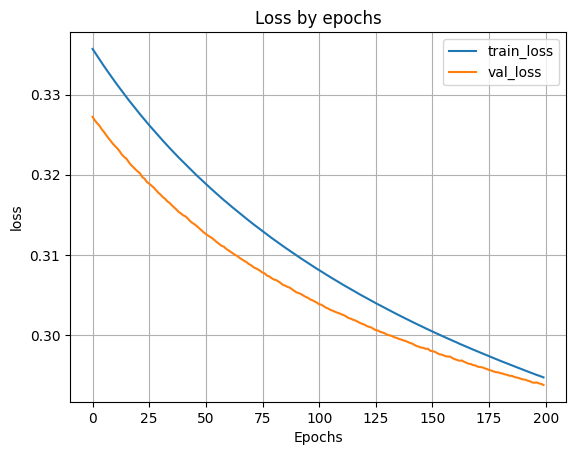

6. Реализация и обучение однослойной нейронной сети

- 6.1.Создали модель, объявиил ее объектом класса Sequential и скомпилировали.

model_p = Sequential()

model_p.add(Dense(units=num_classes,input_dim=num_pixels, activation='softmax'))

model_p.compile(loss='categorical_crossentropy', optimizer='sgd', metrics=['accuracy'])

- 6.2. Вывели архитектуру модели

model_p.summary()

- Обучил модель

H_p = model_p.fit(X_train, y_train,batch_size = 512, validation_split=0.1, epochs=200)

- Вывели график функции ошибок

plt.plot(H_p.history['loss'])

plt.plot(H_p.history['val_loss'])

plt.grid()

plt.xlabel('Epochs')

plt.ylabel('loss')

plt.legend(['train_loss','val_loss'])

plt.title('Loss by epochs')

plt.show()

7. Примененили модели к тестовым данным

scores=model_p.evaluate(X_test,y_test);

print('Loss on test data:',scores[0]);

print('Accuracy on test data:',scores[1])

accuracy: 0.9178 - loss: 0.2926 Loss on test data: 0.3017258942127228 Accuracy on test data: 0.9168999791145325

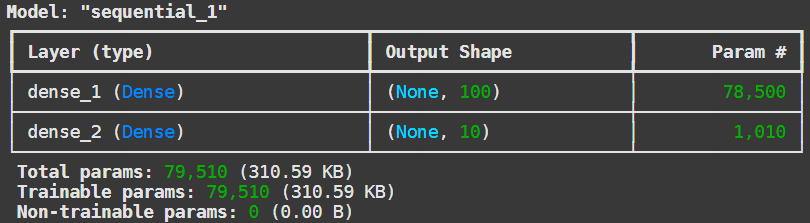

8. Добавили один скрытый слой и повторил п. 6-7

- при 100 нейронах в скрытом слое

model_2l_100 = Sequential()

model_2l_100.add(Dense(units=100,input_dim=num_pixels, activation='sigmoid'))

model_2l_100.add(Dense(units=num_classes, activation='softmax'))

model_2l_100.compile(loss='categorical_crossentropy', optimizer='sgd', metrics=['accuracy'])

model_2l_100.summary()

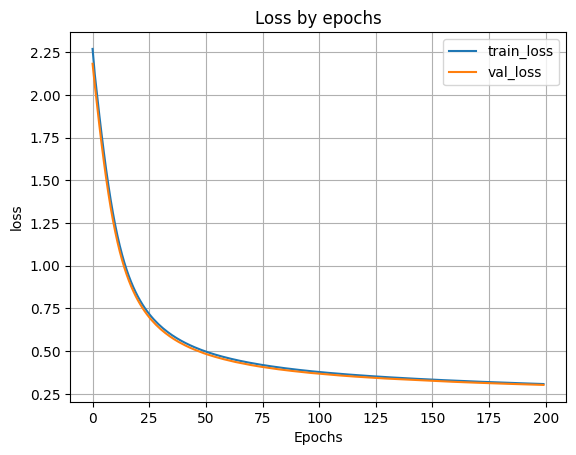

- Обучили модель

H_2l_100=model_2l_100.fit(X_train,y_train,batch_size =512, validation_split=0.1,epochs=200)

- Вывели график функции ошибки

plt.plot(H_2l_100.history['loss'])

plt.plot(H_2l_100.history['val_loss'])

plt.grid()

plt.xlabel('Epochs')

plt.ylabel('loss')

plt.legend(['train_loss','val_loss'])

plt.title('Loss by epochs')

plt.show()

scores=model_2l_100.evaluate(X_test,y_test);

print('Loss on test data:',scores[0]);

print('Accuracy on test data:',scores[1])

accuracy: 0.9166 - loss: 0.3003 Loss on test data: 0.30692651867866516 Accuracy on test data: 0.9154999852180481

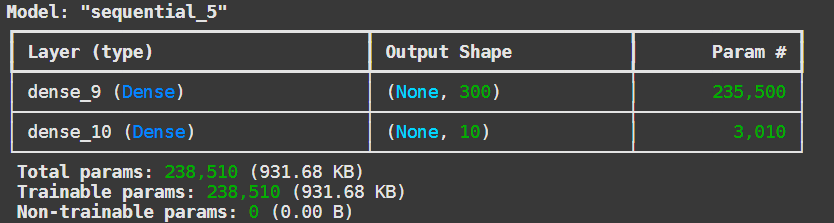

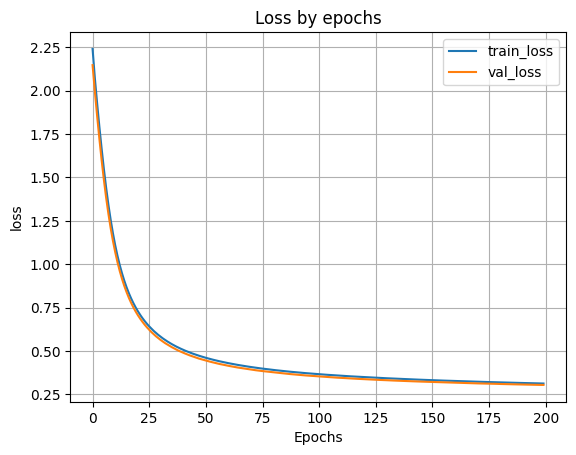

- при 300 нейронах в скрытом слое

model_2l_300 = Sequential()

model_2l_300.add(Dense(units=300,input_dim=num_pixels, activation='sigmoid'))

model_2l_300.add(Dense(units=num_classes, activation='softmax'))

model_2l_300.compile(loss='categorical_crossentropy', optimizer='sgd', metrics=['accuracy'])

model_2l_300.summary()

- Обучили модель

H_2l_300=model_2l_300.fit(X_train,y_train,batch_size = 512,validation_split=0.1,epochs=200)

- Вывели график функции ошибки

plt.plot(H_2l_300.history['loss'])

plt.plot(H_2l_300.history['val_loss'])

plt.grid()

plt.xlabel('Epochs')

plt.ylabel('loss')

plt.legend(['train_loss','val_loss'])

plt.title('Loss by epochs')

plt.show()

scores=model_2l_300.evaluate(X_test,y_test);

print('Loss on test data:',scores[0]);

print('Accuracy on test data:',scores[1])

- accuracy: 0.9155 - loss: 0.3049 Loss on test data: 0.3119920790195465 Accuracy on test data: 0.9139000177383423

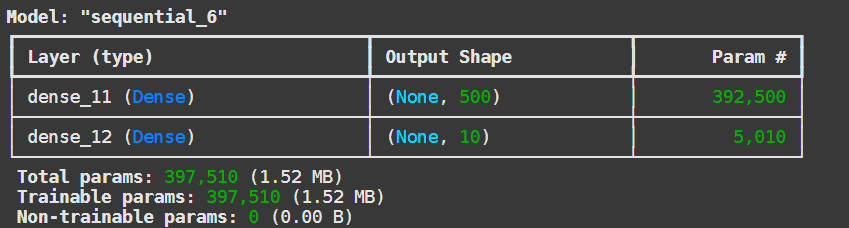

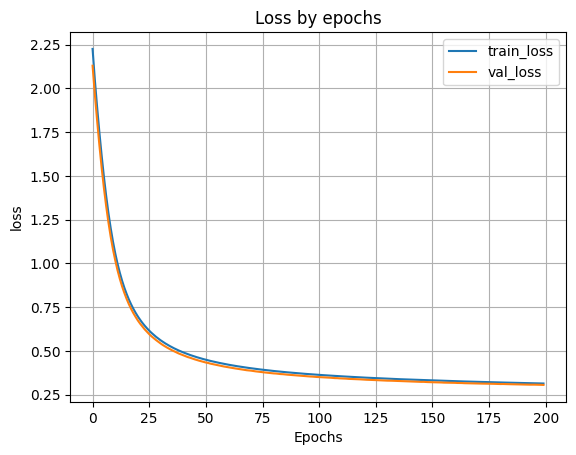

- при 500 нейронах в скрытом слое

model_2l_500 = Sequential()

model_2l_500.add(Dense(units=500,input_dim=num_pixels, activation='sigmoid'))

model_2l_500.add(Dense(units=num_classes, activation='softmax'))

model_2l_500.compile(loss='categorical_crossentropy', optimizer='sgd', metrics=['accuracy'])

model_2l_500.summary()

- Обучаем модель

H_2l_500=model_2l_500.fit(X_train,y_train,batch_size = 512,validation_split=0.1,epochs=200)

- Выводим график функции ошибки

plt.plot(H_2l_500.history['loss'])

plt.plot(H_2l_500.history['val_loss'])

plt.grid()

plt.xlabel('Epochs')

plt.ylabel('loss')

plt.legend(['train_loss','val_loss'])

plt.title('Loss by epochs')

plt.show()

scores=model_2l_500.evaluate(X_test,y_test);

print('Loss on test data:',scores[0]);

print('Accuracy on test data:',scores[1])

accuracy: 0.9138 - loss: 0.3062 Loss on test data: 0.3137015998363495 Accuracy on test data: 0.9122999906539917

Наилучший результат получился у ИНС с 100 нейронами в скрытом слое (0.9154999852180481). В следующих пунктах будем строить 3-х слойную сеть на основе этой конфигурации.

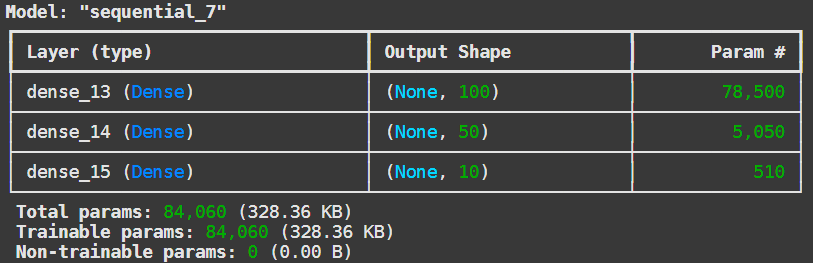

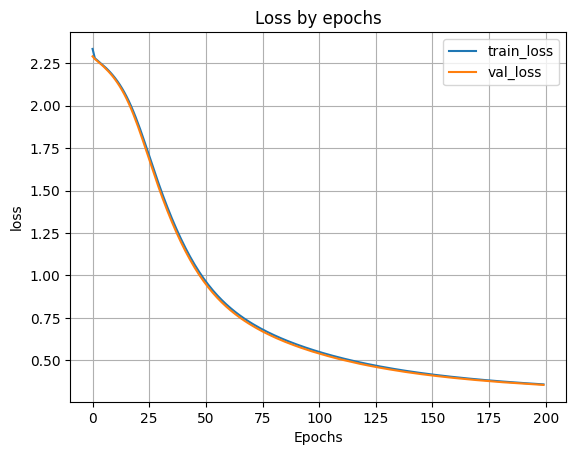

9. Добавление второго скрытого слоя

- при 50 нейронах во втором скрытом слое

model_3l_100_50 = Sequential()

model_3l_100_50.add(Dense(units=100,input_dim=num_pixels, activation='sigmoid'))

model_3l_100_50.add(Dense(units=50, activation='sigmoid'))

model_3l_100_50.add(Dense(units=num_classes, activation='softmax'))

model_3l_100_50.compile(loss='categorical_crossentropy', optimizer='sgd', metrics=['accuracy'])

model_3l_100_50.summary()

- Обучили модель

H_3l_100_50=model_3l_100_50.fit(X_train,y_train,batch_size = 512,validation_split=0.1,epochs=200)

- Вывели график функции ошибки

plt.plot(H_3l_100_50.history['loss'])

plt.plot(H_3l_100_50.history['val_loss'])

plt.grid()

plt.xlabel('Epochs')

plt.ylabel('loss')

plt.legend(['train_loss','val_loss'])

plt.title('Loss by epochs')

plt.show()

scores=model_3l_100_50.evaluate(X_test,y_test);

print('Loss on test data:',scores[0]);

print('Accuracy on test data:',scores[1])

- accuracy: 0.9067 - loss: 0.3484 Loss on test data: 0.3573007583618164 Accuracy on test data: 0.9021999835968018

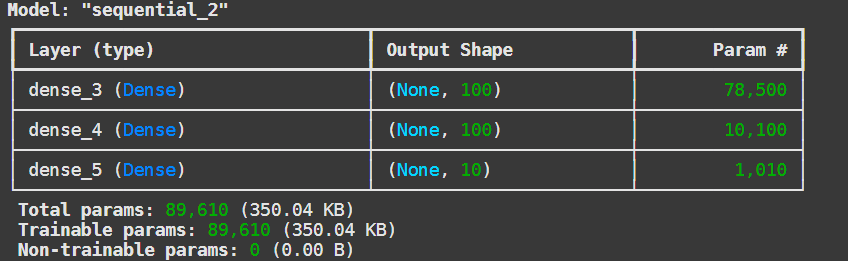

- при 100 нейронах во втором скрытом слое

model_3l_100_100 = Sequential()

model_3l_100_100.add(Dense(units=100,input_dim=num_pixels, activation='sigmoid'))

model_3l_100_100.add(Dense(units=100, activation='sigmoid'))

model_3l_100_100.add(Dense(units=num_classes, activation='softmax'))

model_3l_100_100.compile(loss='categorical_crossentropy', optimizer='sgd', metrics=['accuracy'])

model_3l_100_100.summary()

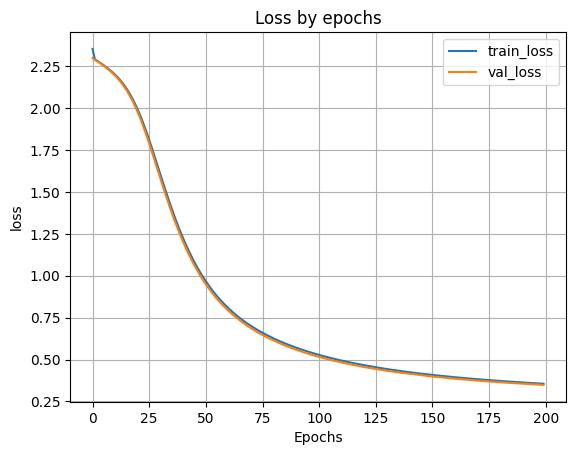

- Обучили модель

H_3l_100_100=model_3l_100_100.fit(X_train,y_train,batch_size = 512,validation_split=0.1,epochs=200)

- Вывели график функции ошибки

plt.plot(H_3l_100_100.history['loss'])

plt.plot(H_3l_100_100.history['val_loss'])

plt.grid()

plt.xlabel('Epochs')

plt.ylabel('loss')

plt.legend(['train_loss','val_loss'])

plt.title('Loss by epochs')

plt.show()

scores=model_3l_100_100.evaluate(X_test,y_test);

print('Loss on test data:',scores[0]);

print('Accuracy on test data:',scores[1])

accuracy: 0.9062 - loss: 0.3420 Loss on test data: 0.35140201449394226 Accuracy on test data: 0.9049000144004822

| Кол-во слоёв | Нейронов в 1-м | Нейронов во 2-м | Accuracy |

|---|---|---|---|

| 0 | – | – | 0.9151999950408936 |

| 1 | 100 | – | 0.9154999852180481 |

| 1 | 300 | – | 0.9139000177383423 |

| 1 | 500 | – | 0.9122999906539917 |

| 2 | 100 | 50 | 0.9021999835968018 |

| 2 | 100 | 100 | 0.9049000144004822 |

По значениям метрики качества классификации можно увидеть, что лучше всего справилась двухслойная сеть с 100 нейронами в скрытом слое. Наращивание кол-во слоев и кол-во нейронов в них не привели к желаемому росту значения метрики качества, а наоборот ухудшили ее. Вероятно связано это с тем, что для более мощных архитектур нужно увеличить обучающую выборку, чем есть сейчас у нас, иначе это приводит к переобучению сети.

11. Сохранение наилучшей модели на диск

model_2l_100.save(filepath='best_model_2l_100_LR1.keras')

12. Вывод тестовых изображений и результатов распознаваний

n = 70

result = model_2l_100.predict(X_test[n:n+1])

print('NN output:', result)

plt.imshow(X_test[n].reshape(28,28), cmap=plt.get_cmap('gray'))

plt.show()

print('Real mark: ', str(np.argmax(y_test[n])))

print('NN answer: ', str(np.argmax(result)))

Real mark: 2 NN answer: 2

n = 888

result = model_2l_100.predict(X_test[n:n+1])

print('NN output:', result)

plt.imshow(X_test[n].reshape(28,28), cmap=plt.get_cmap('gray'))

plt.show()

print('Real mark: ', str(np.argmax(y_test[n])))

print('NN answer: ', str(np.argmax(result)))

Real mark: 6 NN answer: 6

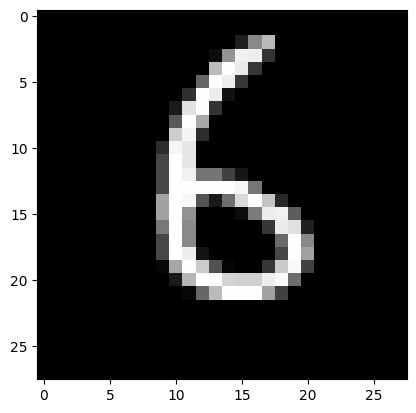

12. Тестирование на собственных изображениях

- загрузили 1-ое собственное изображения

from PIL import Image

file_1_data = Image.open('6.png')

file_1_data = file_1_data.convert('L') #перевод в градации серого

test_1_img = np.array(file_1_data)

- вывели собственное изображения

plt.imshow(test_1_img, cmap=plt.get_cmap('gray'))

plt.show())

- предобработка

test_1_img = test_1_img / 255

test_1_img = test_1_img.reshape(1, num_pixels)

- распознавание

result_1 = model_2l_100.predict(test_1_img)

print('I think it\'s', np.argmax(result_1))

I think it's 6

- тест на 2-ом изображении

file_2_data = Image.open('2.png')

file_2_data = file_2_data.convert('L') #перевод в градации серого

test_2_img = np.array(file_2_data)

plt.imshow(test_2_img, cmap=plt.get_cmap('gray'))

plt.show()

test_2_img = test_2_img / 255

test_2_img = test_2_img.reshape(1, num_pixels)

result_2 = model.predict(test_2_img)

print('I think it\'s', np.argmax(result_2))

I think it's 2

Сеть корректно распознала обе цифры

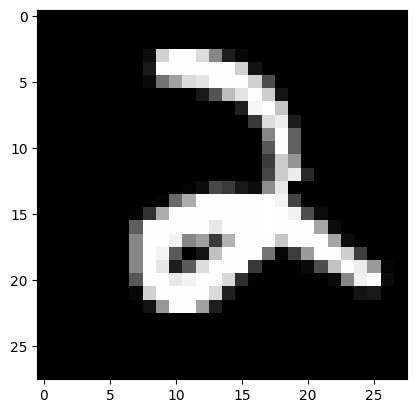

14. Тестирование на собственных повернутых изображениях

file_3_data = Image.open('6_90.png')

file_3_data = file_3_data.convert('L') #перевод в градации серого

test_3_img = np.array(file_3_data)

plt.imshow(test_3_img, cmap=plt.get_cmap('gray'))

plt.show()

test_3_img = test_3_img / 255

test_3_img = test_3_img.reshape(1, num_pixels)

result_3 = model_2l_100.predict(test_3_img)

print('I think it\'s', np.argmax(result_3))

I think it's 9

file_4_data = Image.open('2_90.png')

file_4_data = file_4_data.convert('L') #перевод в градации серого

test_4_img = np.array(file_4_data)

plt.imshow(test_4_img, cmap=plt.get_cmap('gray'))

plt.show()

test_4_img = test_4_img / 255

test_4_img = test_4_img.reshape(1, num_pixels)

result_4 = model_2l_100.predict(test_4_img)

print('I think it\'s', np.argmax(result_4))

I think it's 5

Сеть не смогла распознать ни одну из перевернутых изображений.Связано это с тем, что мы не использовали при обучении перевернутые изображения.